1994年4月26日午後8時16分、台北発名古屋行きの中華航空140便(エアバスA300-600R)は、名古屋空港の滑走路への着陸態勢に入っていた。

順調に進入を続けていたはずの旅客機は、しかし滑走路を目前にして突如機首を持ち上げ、異常な上昇の末に失速し、滑走路脇の着陸帯に尻もちをつくように墜落した。

乗客乗員271名のうち、264名が命を落とした。今からちょうど32年前に起きた、日本の航空史上屈指の悲劇である。

事故調査報告書や裁判で認定された経緯を追っていくと、この事故には興味深い視点が浮かび上がる。墜落に至る数分間、コックピットには機長と副操縦士の2人のパイロットに加え、もう1人、言葉を持たない「3人目のパイロット」がいた――。自動操縦システムである。

この3者の意図が噛み合わなかったことが、旅客機を墜落させた。今回はそんな視点からこの事故を振り返ってみたい。

なお、事故から30年以上が経ってもなお、ご遺族や被害者の悲しみや傷は癒えるものではない。そのことを念頭に、慎重に書き進めたい。(島崎敢・近畿大学教授(安全心理学))

「3人目のパイロット」との綱引き

きっかけは小さな触れ間違いだった。

140便は副操縦士の手動操縦で、名古屋空港の滑走路34に向けて正常に降下していた。午後8時14分過ぎ、気圧高度約1070フィート(約330メートル)を通過した頃、副操縦士はうっかりエンジンスロットルレバーの下にある「ゴーレバー」に触れ、作動させてしまった。

ゴーレバーは、着陸をやり直す(ゴーアラウンドする)ためのスイッチである。これが押されると、自動操縦システムは「ゴーアラウンドモード」に切り替わり、エンジン推力を上げて機首上げの準備に入る。本来は先行機との衝突を避けたい時など、着陸を中止したい局面で使われる安全装置だが、副操縦士はこれに意図せず触れてしまったのだ。

機長はすぐに「君、ゴーレバーを引っ掛けたぞ」と指摘し、「それを解除して」と副操縦士に指示した。しかしここで問題が起きる。副操縦士はゴーアラウンドモードを解除しようとするのだが、解除方法がわからず、うまく解除できない。

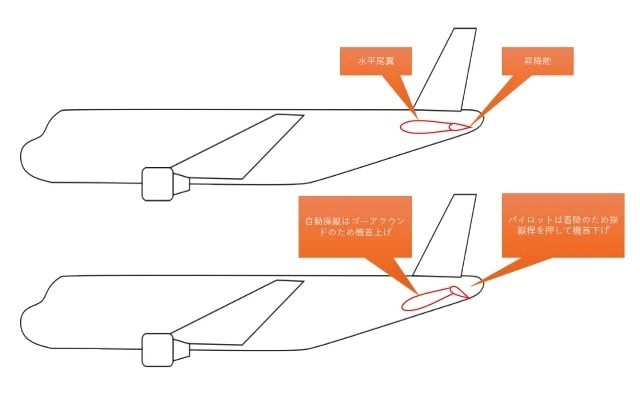

ここから事態は決定的に悪化する。副操縦士は機体を降下させようと操縦輪(航空機のハンドル)を強く押し続けた。これを受けて主翼後縁の昇降舵(しょうこうだ)は機首下げの方向に動く。

ところが自動操縦は「ゴーアラウンド」の指示のもと、水平尾翼を機首上げの方向に動かしていく。副操縦士の意図と自動操縦が真っ向から対立し、昇降舵と水平尾翼が「くの字」に開き、機体は極めて不安定な状態に陥った(図1)。

副操縦士は「着陸したい」と操縦輪を押していた。一方の自動操縦も「着陸をやり直すために上昇する」という任務を忠実に実行しようとしていた。両者はお互いに真面目に仕事をしていたのだ。問題は、お互いが何をしようとしているかを共有できていなかったことにある。

自動操縦システムは口がきけないが、自分が何をしようとしているかを「フライトモード表示器」という画面に表示することで伝えている。そこには「ゴーアラウンド」と明確に表示されていた。3人目のパイロットは「私は上昇するつもりです」と画面で叫んでいた。しかし、副操縦士も機長もこの表示を十分に読み取れず、「着陸進入中」のつもりで操縦を続けた。

機長と副操縦士の間でも、適切なコミュニケーションがなかったか……

しかも「綱引き」を続けた結果、副操縦士が押していた操縦輪は、通常の4〜5倍の力(20kg以上)を要するほど重くなっていた。これは「自動操縦と戦っている証拠」であり、操縦の基本を学んだパイロットであれば、操縦輪の異常な重さから機体のトリム(姿勢)が大きく狂っていることに気づけたはずだった。しかし副操縦士は機長から「もっと押して、もっと押して」と指示されるまま、ひたすら操縦輪を押し続けた。

副操縦士は「ゴーアラウンドモードを解除できない」「操縦輪が異常に重い」という事態の深刻さを示す重要な情報を、機長に的確に伝えていない。最終盤に「教官、やっぱり押し下げられません」と口にしてはいるが、その時にはもう機体の姿勢は回復困難な状態になっていた。機長もまた、副操縦士の操作の異常さに気づきながら、根本的な原因を究明しようとはしなかった。

航空機の安全においては、乗員同士が遠慮なく異常を共有できる「心理的安全性」の高さが極めて重要だと言われている。立場を超えて誰もが言いたいことを言える雰囲気があれば、副操縦士はもっと早い段階で「解除できません」「操縦輪がおかしいです」と声を上げ、機長と一緒に原因を探れたかもしれない。

機長がようやく「私がやる」と操縦を引き継いだ時にはもう遅かった。水平尾翼は機首上げ方向の限界まで到達しており、機長は着陸を諦めてエンジン推力を最大にしたが、これが既に限界まで上げられていた水平尾翼の効果と相まって、機体を急激に機首上げにした。140便は最大で53度近い異常な機首上げ姿勢に達して失速し、墜落した。

事件と同じ「インシデント」が3回も起きていた

ここでもう一つ触れておきたいのは、実はこの事故の前に、同型機で人間と自動操縦の意図が対立して機体が異常な姿勢に陥るインシデントが1985年、1989年、1991年と3回も起きていたことだ。

特に1989年にヘルシンキで発生した事例は、ゴーレバーの誤作動を発端として操縦輪を押し続けたという点で、中華航空機の事故とそっくりの経緯である。これらのインシデントでは、いずれもたまたま高度に余裕があったことや、機長がとっさの判断で適切に対応できたことで、事なきを得ていた。

これらのインシデントを受けて、エアバスは事故の前年の1993年6月に、自動操縦の設計を改修するための技術通報を発行していた。操縦輪に一定以上の力が加わればオートパイロットが解除されるようにする、という改修である。

ところがこの通報の適用ランクは「Mandatory(義務)」ではなく「Recommended(推奨)」にとどめられていた。そのため、事故を起こした140便には改修が適用されないまま運用が続いていたのだ。

過去3回の重大インシデントから得られた教訓は、十分に活かされていなかった。

なお、この事故を受けて、エアバスは同型機の自動操縦システムを全面的に改修した。現在では、どのフライトモードであっても、操縦輪に一定以上の力が加われば自動操縦は解除される。つまり「人間と機械の綱引き」が構造的に起こらないようにシステム自体を作り変えたのだ。

地上でも同じことは起きうる

中華航空機の事故から32年、今度は地上で同じような事故が発生しかねない状況が生まれつつある。

それは、自動運転システムを搭載した自動車の普及が進んでいることである。

前を走る車に自動追従する機能、車線を自動で維持する機能、障害物を検知して自動ブレーキをかける機能などは、もはや珍しい装備ではなくなった。言い換えれば、運転席にもう1人、物言わぬ「2人目のドライバー」が同乗するようになったのだ。事故発生のリスクは低下していく方向にあるかに見える。

しかし、ここで立ち止まって考えておきたい。

中華航空機の事故を起こした2人のパイロットは、膨大な訓練を積み、定期的に審査を受け、資格を維持している飛行のプロフェッショナルだった。そんなプロフェッショナルですら、自動化システムの振る舞いを読み切れず、機械との「意図の食い違い」で事故を起こした。飛行機のパイロットでさえ起こしてしまったコミュニケーションエラーが、訓練を受けていない一般ドライバーの間で起きないと考えるのは、あまりにも楽観的だろう。

ではどうすれば良いのか。まず自動車メーカーや自動運転システムの設計者は、自動化システムが人間と意図を食い違えた時に大事故にならないよう、設計そのもので対策を打つ必要がある。

「運転者が注意すれば大丈夫」という前提は、それこそ中華航空機事故の調査報告書が繰り返し否定してきた考え方である。人間はミスをするし、ストレス下ではシステムの状況を正しく認識できないこともある。そもそもシステムが何をしているのかを正しく認識できていないこともあるだろう。それを前提にシステムを作らなければならない。

中華航空機の事故機を設計したエアバスの技術者たちが、手を抜いていたわけではない。むしろ、想定される故障に対して真面目に設計していた。

それでも、実際に運用してみたら、設計時には想像もしなかったような事態の連鎖で事故が起きてしまった。これが複雑なシステムの厄介なところだ。自動運転もおそらく、設計段階でいくら想定を尽くしても、実運用の中で予想外のエラーは必ず見つかる。

だからこそ設計者は、事故やインシデントの情報を迅速に収集・分析し、必要があれば躊躇なく設計を改修させる姿勢が求められる。中華航空機事故で、先行する3件のインシデントから得られた教訓が活かされなかったのと同じ過ちを自動運転の世界で繰り返してはならない。

一方で自動運転システムを利用するユーザー側、つまり私たちドライバーにも役割がある。

自分の車のシステムに「何ができて」「何ができないのか」、どんな条件で作動・解除されるのかを、使う前にきちんと理解しておくことだ。一時停止標識に反応してブレーキをかけてくれると思い込んでいたら、そうではなかった。前の車に追従してくれるはずが、特定の条件では追従してくれなかった。こうした認識のズレが、名古屋の上空で起きたことと同じ構造の事故を地上で引き起こしうる。

運転席のあなたの隣にいる「2人目のドライバー」が何を考え、何をしようとしているのか、取扱説明書や表示画面から読み取ろうとする姿勢が、これからのドライバーには求められている。

それでも自動化は進めるべきだ

こういう話をすると、「だから自動化は駄目なんだ、人間が運転するのが一番だ」という意見が出てきそうだが、筆者はそうは思わない。統計的に見れば、機械のエラー率は人間のエラー率よりもはるかに低い。

交通事故の大部分は人間のミスによって起きているのであり、自動化の進展によって救われる命の数は、自動化によって失われる命の数を大きく上回ると考えられている。自動化が私たちにもたらす安全と利便性のメリットは、きわめて大きいだろう。

ただし、自動化が進む過渡期には、これまで起こらなかった種類の事故が起きることも事実である。大切なのはこの事実から目を背けず、リスクを冷静に認識し、設計とユーザー双方の努力でそれを抑え込みながら、自動化の恩恵を享受していくことだろう。

名古屋の上空で264名の命と引き換えに得られた教訓を、私たちは今、地上でも活かさなければならない。犠牲となった方々のご冥福を、改めてお祈りしたい。

■島崎敢

1976年東京都生まれ。早稲田大学大学院にて博士(人間科学)取得。同大助手、助教、防災科学技術研究所特別研究員、名古屋大学特任准教授を経て、近畿大学准教授。元トラックドライバー。全ての一種免許と大型二種免許、クレーンや重機など、多くの資格を持つ。心理学による事故防止や災害リスク軽減を目指す研究者で3人の娘の父親。趣味は料理と娘のヘアアレンジ。著書に「心配学〜本当の確率となぜずれる〜」(光文社)等。