性犯罪者に狙われる子どもたち

2025年3月に起きた、小中学校教員のグループが女子児童を盗撮し、SNSで共有していたとされる事件。同年3月10日に1人目が逮捕され、7人目が11月6日に逮捕されました。犯人らは少女が着替えをする様子などを撮影し、SNSのグループチャットで写真を共有していたとされています。安全なはずの学校で起きた性犯罪に驚きと怒りを感じた人は私だけではないと思います。

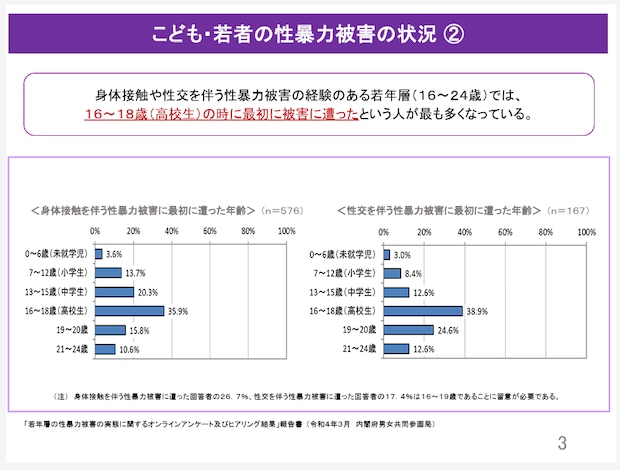

内閣府男女共同参画局が2023年6月にまとめた「こども・若者の性被害に関する状況等について」(※1)によると、身体接触や性交を伴う性暴力被害に遭った人は0歳~6歳が約3%、7~12歳は10%前後という結果が出ています。

「こども・若者の性被害に関する状況」(出典:内閣府男女共同参画局)

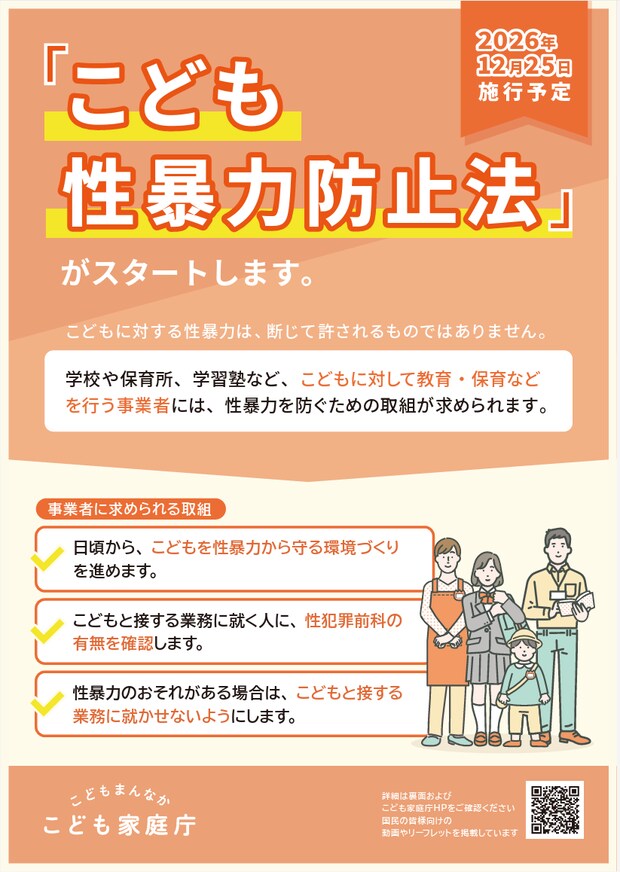

言うまでもありませんが、子どもに対する性犯罪はその後の人生に重大な影響を与えます。そこで、2024年6月に教育・保育などの子どもに接する場での子どもへの性暴力を防ぎ、子どもの心と身体を守るため、「こども性暴力防止法」が成立しました。この法律は2026年12月25日より施行される予定です。

「こども性暴力防止法」パンフレット(出典:こども家庭庁)

こども性暴力防止法には、「日本版DBS」と呼ばれる措置が含まれています。DBSとはイギリス司法省管轄の「Disclosure and Barring Service(犯罪証明管理及び発行システム)」の略称で、性犯罪歴をデータベース化し、性犯罪者が子どもに関わる仕事に就かないようにして子どもを守る仕組みです。すでにアメリカ、フランス、ドイツなどでも同様の制度が導入されており、日本でもいよいよ実施されることになりました。

制度が開始されると、事業者は従事者に性犯罪前科の有無を確認することが求められます。不同意性交や児童買春、痴漢、盗撮などの性犯罪が対象です。もし前科が確認された場合は、配置転換などの措置が必要になります。

対象となる事業は、学校や保育所、児童養護施設などです。教員や保育士など、子どもに関わる仕事に従事する人に対して前科の確認などの義務が生じます。放課後児童クラブや学習塾も、国が認定すると制度の対象になるそうです。

早く施行して安心させてほしいところですが、おおよそ一年待つ必要があります。

生成AI悪用による新たな性犯罪「卒アル問題」

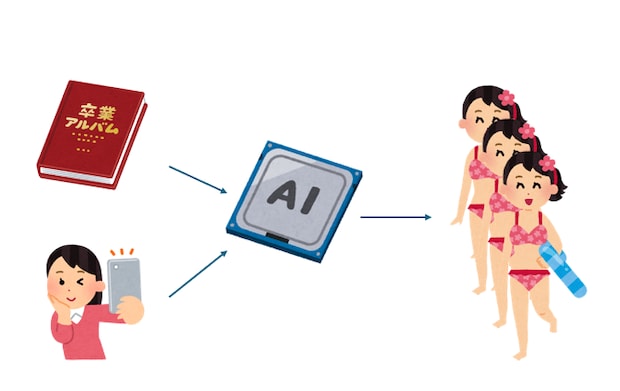

生成AIの進化と普及に伴い、悪用されるケースも増えてきました。そのひとつに「卒アル問題」があります。卒アル問題とは、卒業アルバムの写真を無断でわいせつな画像に加工し、公開する行為です。

卒業アルバムやSNSからディープフェイクポルノを作成(筆者作成)

日本経済新聞によると、2025年11月、わいせつ画像に加工されることを知りながら卒業アルバムの顔写真を部外者に提供したとして沖縄県立高に勤めていた実習助手が懲戒免職処分になりました。合成された写真はSNSに投稿され、実習助手はその投稿にコメントを添えて再投稿していたそうです。(※2)

この事例のように、卒業アルバムの顔写真があれば、わいせつな画像が生成できてしまうのです。「ディープフェイクポルノ」と呼ばれるこうした行為は、これまでは高度なテクニックや専用のソフトウェアが必要だったため、被害者は芸能人や有名人などの一部の人に限定されていました。しかし、生成AIを利用して誰もが大量のディープフェイクポルノを作成できるようになったため、被害が一般人にも及ぶようになったのです。ディープフェイクポルノは、Webサイトに公開されているサービスでも作ることができると言われています。

こうしたディープフェイクポルノは、本人が知らないところで行われてしまうことが大きな問題です。用心してSNSに画像をアップしていなくても、卒業アルバムや学校行事の写真などから生成されてしまう危険があります。