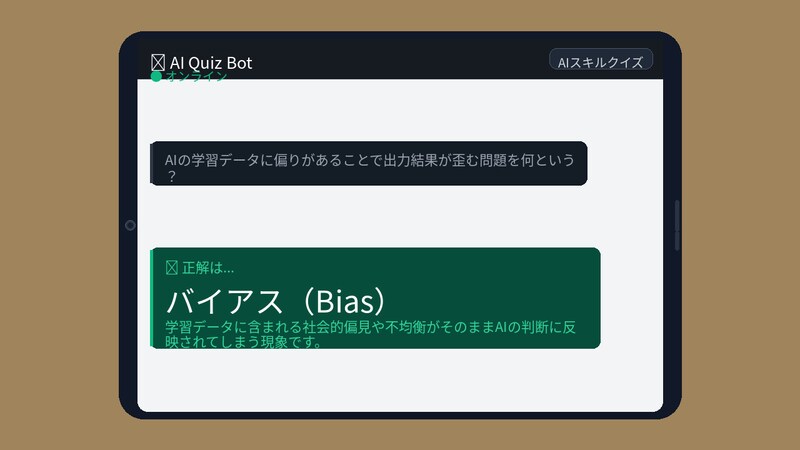

【問題】

AIは万能に見えて、実は学習データ次第でとんでもない偏りを持つことがあります。この問題を知らずにAIを使うのは、かなり危険かもしれません。

★ ヒント

AIが特定の性別や人種に対して不公平な結果を出すニュースを聞いたことはありませんか?その原因となっている概念です。

【解説】

バイアスとは、AIの学習データに含まれる偏りが原因で、出力結果が特定の方向に歪んでしまう問題のことです。たとえば、採用AIが過去の男性中心の採用データで学習した結果、女性の応募者を不利に評価してしまった事例が実際にありました。画像生成AIでも「医者」と入力すると男性ばかり生成されるなど、社会的なステレオタイプが反映されることがあります。これはAIが「悪意」を持っているのではなく、学習データが現実社会の偏りをそのまま含んでいるために起こります。現在、多くのAI企業がバイアスを検出・軽減する技術の開発に取り組んでいます。AIを活用する側もこの問題を理解し、出力結果を鵜呑みにしない姿勢が求められています。

AIの弱点を知ることが、AIを正しく使いこなす第一歩です。次回もAIリテラシーが試されるクイズをお届けします!

さらにもう一問!

▶ 【AIクイズ】知ったかぶりしてない?AI用語の基本中の基本!